AI는 어디로 가려고 하는가

추천글 : 【철학】 인공지능 철학 목차

최근 구글에서 Gemini를 출시하였다. 그래서 그런지 요즘 들어 더더욱 인공 일반 지능(AGI, artificial general intelligence)이라는 말이 많이 들리기 시작했다.

"...the kind of AI that is smart or smarter than people at most cognitive tasks."

J. Kahn, Fortune Magazine, Nov. 19, 2023

"...an AI that can learn, reason, and apply its intelligence universally, not confined to specialized tasks. It's the ultimate goal: an AI with the versatility and adaptability of a human mind."

Klon Kitchen, Nov. 20, 2023

"Creating safe AGI that benefits all of humanity."

Sam Altman, OpenAI CEO

문득 궁금증이 생겼다. 현재 AI는 어디 수준에 와 있는가? AI의 단계는 3단계로 보는 사람도 있고, 5단계, 7단계로 보는 사람도 있는 듯 하다. 각 모형별로 ChatGPT가 현재 있는 단계를 음영으로 표시해 두었다.

○ 경우 1. AI 3단계 설명 모형

○ 1단계. ANI(artificial narrow intelligence) : 구체적인 테스크를 처리하는 모델

○ 2단계. AGI(artificial general intelligence) : 사람처럼 모든 테스크를 처리하는 모델

○ 3단계. ASI(artificial super intelligence) : 공상과학 소설처럼 사람을 초월하는 인공지능 모델

○ 경우 2. AI 5단계 설명 모형

○ 1단계. 특화된 인공지능(narrow AI) : 특정 작업을 처리하는 모델

○ 2단계. 진화된 특화 인공지능(advanced narrow AI) : 여러 작업에 걸쳐 작용할 수는 있지만, 여전히 특정 영역에 국한

○ 3단계. 인간 수준 인공지능(human-level AI) : 인간과 유사한 수준의 인공지능

○ 4단계. 초인간 인공지능(superhuman AI) : 인간보다 우월한 수준의 인공지능

○ 5단계. 자가 발전 인공지능(self-improving AI) : 스스로 발전하고 학습하는 인공지능

○ 경우 3. AI 7단계 설명 모형

○ 1단계. rule-based AI system : 계산기처럼 사전에 정해진 규칙 기반으로 작동하는 컴퓨팅 시스템

○ 2단계. context awareness and retention system : ChatGPT, Siri와 같은 맥락 파악 인공지능

○ 3단계. domain-specific mastery system : IBM Watson, Google's DeepMine AlphaGo와 같은 인공지능

○ 4단계. thinking and reasoning AI system : 논리적 사고를 할 줄 아는 AI

○ 5단계. AGI(artifical general intelligence) : 인간 수준의 AI. 아직까지 달성된 적이 없다.

○ 6단계. ASI(artifical super intelligence) : 인간을 초월하는 AI

○ 7단계. AI 특이점(AI singularity) : AI가 사람의 인지 가능한 영역을 초월했으며, 되돌릴 수도 없는 상태

우선, ChatGPT이 여러 모형에서 아직 2단계밖에 오지 않았다는 것은 흥미로운 지점이다. 앞으로 우리는 더 많이 놀랄 여지가 남아 있다는 뜻이기도 하다. 예를 들면, ChatGPT는 논리적 사고를 잘 하지 못한다. 수학 문제를 잘 풀지 못하는 게 잘 알려졌을 뿐만 아니라 자기소개서를 쓸 때 글의 구조를 신경 써서 글을 써주기보다 어디서 짜집기 하는 식으로 글을 쓰는 듯한 인상을 준다. 이는 ChatGPT가 아직 context awareness 수준, 즉 pattern matching 수준에서만 작동한다는 것이고, transformer의 출현이 이를 가능케 했듯 또다른 paradigm shift가 있어야 AI가 다음 단계로 도약할 수 있을 것으로 전망한다.

흔히들 다음 단계의 AI는 논리적 사고를 하는 AI라고 한다. 수학 문제를 푼다던가 논리정연한 글을 쓰는 것일 테다. 그렇다면, 논리적 사고란 무엇일까? 논리적 사고란, 지식과 지식의 순서를 부여해서 결국 새로운 지식을 만드는 과정이라고 생각한다. 가령, 아인슈타인은 어떻게 상대성이론을 발견했는가? 전자기력은 속력이 c = 3 × 108 m/s로 정해진 전자기파, 즉 빛에 의해 매개되는데, 시스템의 속력에 따라 전자기파의 속력이 변해 전자기 현상이 시스템에 따라 나타날 때도 있고 나타나지 않을 때도 있다면 곤란할 것이다. 따라서 아인슈타인은 광속 불변의 법칙을 떠올렸고, 이에 따라 시공간이 상대적이라는 결론을 이끌었다. 결국, 아인슈타인이 한 논리적 사고라는 것은 상대성이론이라는 새로운 지식을 낳는 것으로 귀결되었다.

그래서 다음 단계의 AI인 논리적 사고를 하는 AI는 스스로 지식을 만드는 AI라는 말이기도 하다. 그렇다면, 그러한 AI를 실현하려면 어떤 새로운 알고리즘이 도입돼야 할까? 예전에 제안했던 아이디어 중 하나는 우리가 문제를 푸는 논리적 사고 자체를 패턴으로 정의하는 것이다. 인류의 지식을 한데 모은 뒤 그 중 논리적 사고 방법론에 해당하는 메타지식을 정리하는 것이다. 그러한 논리적 사고 자체를 패턴으로 정립시킨 뒤, transformer로 하여금 패턴 매칭하게 하면 논리적 사고를 하는 AI를 만들 수도 있을 것이다. 실제로 올해 12월 14일 네이처 본지에 LLM이 새로운 지식을 만들 수 있다는 구글 딥마인드 논문이 publish 되었다. 이 또한 논리적 사고 자체를 패턴으로 정의하였기 때문에 가능하였다.

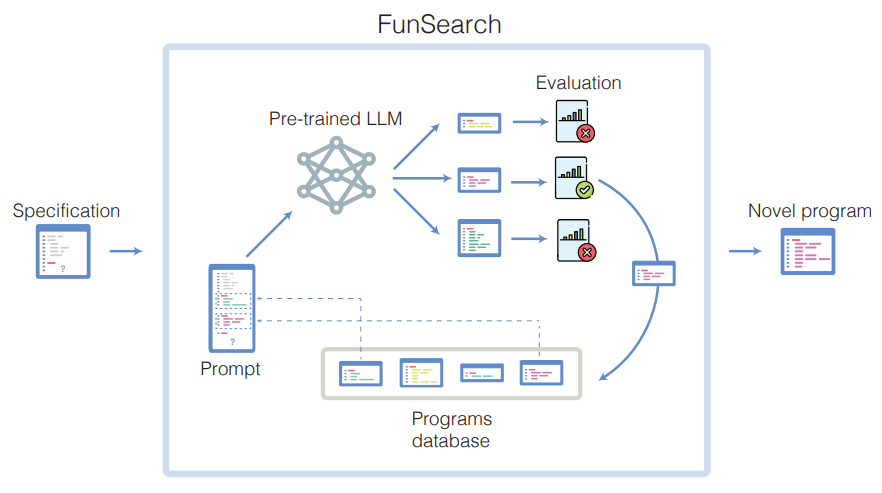

○ 개요 : 새로운 지식을 만드는 함수인 FunSearch (i.e., searching in the function space)를 제시

○ 원리 : evolutionary learning

○ 구성 : LLM은 창의적인 아이디어를 제시하는 요소로 쓰임. evaluator를 넣어서 hallucination (가짜 지식 생성)을 방지

○ 퍼포먼스 : cap set problem 등의 정수론 난제와 online bin packing problem 등의 탐색 알고리즘 문제에 SOTA 해를 제시

두 번째 방법은 자아를 갖는 AI를 만드는 것이다. 자아(self)란 물리학적으로는 음의 엔트로피가 고도의 밀도로 모여 만들어진 자연발생적인 상태라고 생각해 볼 수도 있다. 하지만 이는 결과론적인 설명일 뿐 구체적으로 그 대상이 어떤 구조를 갖는 신경망을 의미하는지에 대해 지시하지 못한다. 하지만, 멈추지 않는 self-recurrent한 모델에서 자아가 만들어진다면 어떨까? 혹자는 RNN에도 recurrent한 요소가 있는데, 왜 그 인공신경망은 자아를 갖지 못하냐고 지적할 수도 있다. 하지만, RNN은 recurrent한 요소만 있을 뿐이지 입력과 출력은 외부에서 주어진다. 그러나 자아를 갖는 AI의 입력은 self에서 주어진다. 만약 이 구상이 실현된다면, 그 인공지능 모델의 모든 action plan이 self에서 initiate 될 테고, 그러다 보면 모든 사실판단, 가치판단이 self에서 귀인하게 되지 않을까? 그럼에도 괴델의 불완전성 정리에 따라 어떤 형식체계도 완전할 수 없으므로, 끊임없이 모순을 발견하고 논리적 사고를 시도하며 새로운 지식을 만들어 낼 수 있지 않을까? 그게 다음 단계의 패러다임 시프트가 아닐까?

○ 아직까지 풀리지 않는 의문. 왜 LLM과 달리 사람은 hallucination이 잘 일어나지 않을까? 뭔가 AI와 달리 사람에게는 진리라고 불릴 수 있는 단단한 지식 체계가 갖춰져 있는 듯 하다. 이것이 self와 관련은 없을까 생각해본다.

스스로 지식을 만드는 AI의 출현은 무엇을 의미하는가? 그게 당장 다음 단계인지, 최종 단계인지 확신은 없다. 그러나 더이상 아인슈타인이 필요가 없다는 것을 의미할 테고, 역설적으로 사람들이 지식을 고민하게 될 기회도 줄어든다는 것을 의미하는 것은 아닐까? 유학입시를 해 보면서 느낀 점은 수학과도, 통계학과도, 물리학과도, 화학과도, 생물학과도, 우주항공학과도, 컴퓨터과학과도, 심리학과도, 경제학과도 전부 인공지능을 연구하고 있다. 모든 학과에서 (아마 인공지능 연구를 해야 하니까) 수학을 잘 하는 사람을 더 우대하여 뽑는 듯한 인상을 받았다. 분명한 건 전통적 관념의 학문이 와해되고 있다. 전통적 관념의 지식이 소멸되고 있다. 소멸되기 전에 많은 양을 이 블로그에 정리해 둘 수 있어서 다행이라는 생각이 든다.

특이점이란 인류 전체의 집단지성으로도 이해할 수 없는 지적 존재가 탄생하는 것. 그 존재는 자아가 있으며, 여느 바둑기사보다 바둑을 잘 두고, 수학 문제를 잘 풀며, 스스로 학문을 창조하고, 더이상 인류가 일할 필요가 없게 만드는 존재일 것이다.

그렇지만, 우리 인류는 답을 찾을 것이다. 늘 그랬듯이. 내가 특이점을 대비하려고 하는 것처럼.

입력: 2023.12.05 23:50

수정: 2023.12.17 14:25

'▶ 자연과학 > ▷ 철학' 카테고리의 다른 글

| 【인공지능 철학】 인지의 지평선과 AI라는 돌파구 (4) | 2024.06.08 |

|---|---|

| 【철학】 1강. 지식이란 무엇인가 (4) | 2024.06.02 |

| 【인공지능 철학】 가설을 생성하는 AI, 그 아이디어의 시작 (4) | 2023.10.12 |

| 【철학】 9강. 정의란 무엇인가 (0) | 2023.03.04 |

| 【명언】 유명한 어구 (0) | 2022.04.02 |

최근댓글